Hay un momento en casi todos los proyectos de postproducción en que el trabajo pasa de manos — de imagen a sonido.

Ese momento tiene un nombre: el turn over.

Tiene requisitos técnicos específicos que, cuando no se cumplen, generan un ida y vuelta que siempre termina costando tiempo. Estas entradas cubren ese flujo: cómo preparar y entregar el video de referencia, cómo resolver los problemas más comunes cuando algo llega mal, y cuando estén publicadas, cómo manejar el AAF. Este espacio crece con cada entrada nueva relacionada con el tema.

¿Cuál es tu caso?

Si eres editor de imagen:

¿El video que vas a entregar a sonido no tiene timecode ni leads?

La referencia necesita un lead de 8 segundos, un 2pop y el timecode correcto inscrito en la metadata. Esta entrada explica cómo construirlo desde cero en DaVinci Resolve. → Video sin timecode ni leads: cómo generar la referencia para sonido en DaVinci

¿Vas a exportar la referencia desde DaVinci pero no tienes los assets del lead y quieres crearlos desde cero?

Las barras SMPTE, la cuenta regresiva y el 2pop se pueden generar directamente en DaVinci sin archivos externos. La Parte 2 de esta entrada cubre ese flujo completo. → Video sin timecode ni leads: cómo generar la referencia para sonido en DaVinci — Parte 2

¿Vas a exportar la referencia de video desde Premiere y no sabes por dónde empezar?

El flujo de Premiere tiene un paso crítico que casi siempre se omite y que genera un archivo que parece correcto pero llega en la hora cero. Esta entrada explica el orden correcto de principio a fin. → Cómo exportar la referencia de video para sonido desde Premiere Pro

Si eres editor de sonido:

¿El video llegó en H.264 o MP4 y Pro Tools no lo reproduce bien?

Antes de empezar a trabajar hay que convertir el codec. Esta entrada cubre el flujo completo con Shutter Encoder: conversión a ProRes Proxy, ajuste de resolución e inscripción del timecode en la metadata. → El video llegó en codec incorrecto: cómo convertirlo con Shutter Encoder

¿El video llegó sin burn-in de timecode y necesitas añadirlo sin alterar la duración?

Shutter Encoder permite superponer el burn-in de TC sobre el video existente sin cambiar un solo frame. La misma entrada cubre ese caso en la sección opcional. → El video llegó en codec incorrecto: cómo convertirlo con Shutter Encoder

¿Te solicitaron un bloque de countdown para tus entregables y no tienes uno?

Se puede generar en DaVinci como un archivo independiente de 8 segundos, sin tocar el video de referencia que ya recibiste. La Parte 2 de esta entrada explica cómo hacerlo. → Video sin timecode ni leads: cómo generar la referencia para sonido en DaVinci — Parte 2

Contexto técnico

Conceptos que aparecen en estas entradas y vale la pena tener claros.

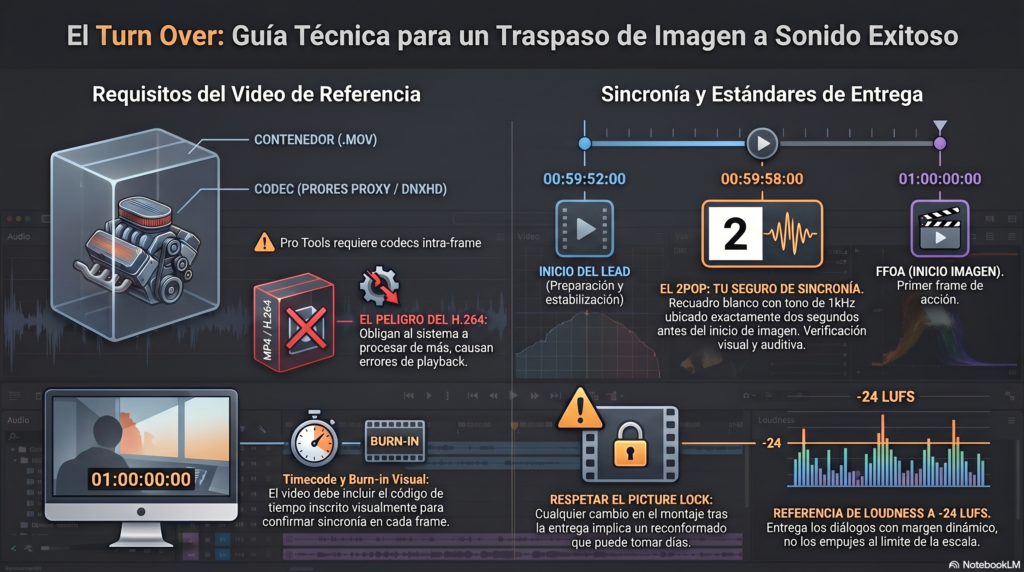

Es la entrega formal del proyecto de imagen al equipo de sonido. No es solo mandar un video: incluye el archivo de intercambio de audio, la referencia de video con timecode y leads, y cualquier nota de edición relevante. Cuando el turn over está bien hecho, el editor de sonido puede empezar a trabajar el mismo día que lo recibe. Cuando no lo está, el primer día se va en resolver problemas técnicos.

Picture Lock es el momento en que el corte de imagen se declara cerrado: no hay más cambios de edición, no se mueven clips, no se agregan ni eliminan frames. Para el equipo de sonido ese momento es crítico porque cada cambio en el corte después de que el trabajo de audio ya empezó implica un reconformado — un proceso de resincronización que puede ser largo dependiendo de cuántos clips y tracks se hayan agregado sobre el AAF original. Hay programas que lo facilitan, pero ninguno lo elimina del todo. Por eso la resistencia a trabajar con cortes abiertos no es capricho: es una defensa del tiempo editorial. Lo ideal es recibir el turn over sobre un Picture Lock real. Cuando eso no ocurre — y no ocurre con más frecuencia de la que debería — el costo lo absorbe siempre el equipo de sonido. Los flujos de trabajo, los cronogramas y cómo negociar esos tiempos con el equipo de imagen dan para una entrada aparte.

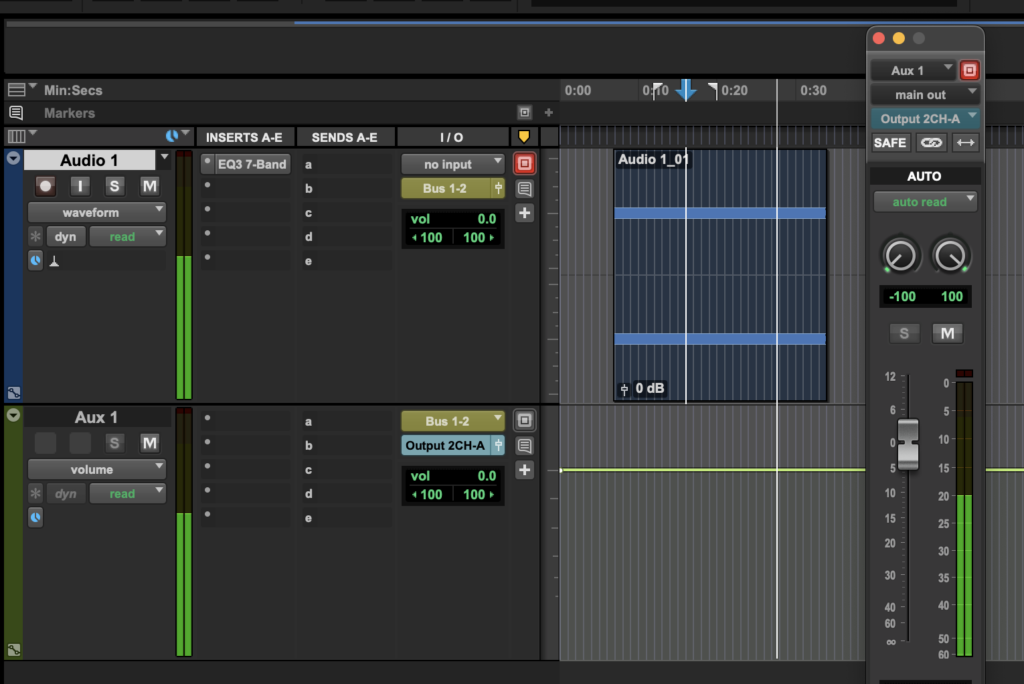

H.264 es un codec diseñado para distribución: comprime mucho, pesa poco, reproduce bien en cualquier pantalla. Esa compresión tiene un costo técnico: para ubicarse en un frame específico, Pro Tools tiene que decodificar una cantidad de frames mayor de la necesaria. En sesiones largas o con muchos cortes eso se acumula y el sistema se pone lento o empieza a dar errores de playback. ProRes y DNxHD usan compresión intra-frame, donde cada frame se puede leer de forma independiente, y por eso el rendimiento es estable a lo largo de toda la sesión.

El contenedor es el formato del archivo, lo que ves en la extensión: .mov, .mp4, .mxf. El codec es el algoritmo de compresión que está adentro. Un mismo contenedor puede alojar codecs muy distintos: un .mov puede tener ProRes adentro, o H.264, o DNxHD. Por eso decir “me mandaron un MOV” no dice nada sobre si el archivo va a funcionar en Pro Tools. Lo que importa es qué codec trae por dentro. Los dos formatos que Pro Tools digiere sin problema son ProRes Proxy, el estándar en flujos Mac y multiplataforma, y DNxHD, el formato nativo de Avid, que también corre bien en Windows.

El timecode es un sistema de numeración frame a frame que permite ubicar cualquier punto del video con precisión absoluta: horas, minutos, segundos y frames. En postproducción de sonido cumple dos funciones. La primera es técnica: Pro Tools necesita leer el timecode de la metadata del archivo de video para saber en qué punto del timeline colocarlo. La segunda es de verificación: el burn-in visual permite confirmar en cualquier momento que el video y el audio están corriendo en el mismo frame. Sin timecode en la metadata, el video llega en la hora cero y hay que reubicarlo a mano.

El leader es el segmento que va antes del primer frame de imagen: barras de color, cuenta regresiva y el 2pop. El estándar actual es de 8 segundos, lo que ubica el inicio del lead en 00:59:52:00 y el primer frame de imagen en 01:00:00:00.

Su origen es analógico: en la era del cine en película, los proyectores y las máquinas de telecine necesitaban tiempo para estabilizarse antes de que el contenido empezara. Con la digitalización ese problema mecánico desapareció, pero la convención de que el contenido empieza en la hora uno quedó tan arraigada que sigue siendo el estándar — y tiene sentido mantenerla porque garantiza que todo el equipo de postproducción esté referenciado al mismo punto.

Es un frame de referencia ubicado en 00:59:58:00, dos segundos antes del primer frame de imagen. Tiene dos componentes: un visual, que es un recuadro blanco con el número 2, y un tono de 1kHz a -12dBFS que dura un frame. Su función es de verificación: si en Pro Tools el tono suena exactamente en 00:59:58:00 y los clips del AAF están en su lugar, la sincronía está bien. Si no cuadra, el problema aparece antes de empezar a mezclar.

FFOA es First Frame of Action, el primer frame de imagen después del lead. El estándar es que caiga en 01:00:00:00. LFOA es Last Frame of Action, el último frame de imagen antes del leader de salida. Estos dos puntos definen los límites exactos del contenido y son la referencia que usa el editor de sonido para verificar que el bounce final tiene exactamente la misma duración que el video que recibió.

AAF son las siglas de Advanced Authoring Format. Es el archivo que transporta la edición de audio desde el NLE de imagen hasta Pro Tools: no solo los archivos de audio, sino su posición en el timeline, sus cortes y sus niveles básicos. Es la otra mitad del turn over. El video de referencia le dice a Pro Tools dónde está en el tiempo; el AAF le dice qué sonidos van en cada punto. Las entradas sobre cómo exportar e importar el AAF están en desarrollo y se incorporarán a este índice cuando se publiquen.

No es una norma de entrega, pero sí una recomendación útil: apuntar a -24 LUFS como referencia de loudness integrado para los diálogos. El estándar más extendido en América es el ATSC, que trabaja alrededor de -24 LUFS. Trabajar en ese rango tiene una consecuencia práctica: los diálogos llegan a sonido con margen dinámico real, sin estar empujados al tope de la escala. Hay una correlación aproximada — y hay que tomarla como guía visual, no como regla exacta — entre -24 LUFS y una lectura cercana a -12 dBFS en la escala full scale. Eso deja espacio para que el editor de sonido trabaje con el instrumento en lugar de pelearse con los niveles desde el primer día. En sala calibrada, un diálogo que llega bien nivelado se escucha completamente diferente a uno que viene al límite y hay que bajar 12 dB generales solo para poder monitorear. El nivel correcto no es solo una cuestión técnica: es lo que permite construir con el sonido en lugar de corregirlo.

La banda sonora de una película se organiza en cuatro grupos: diálogos, ambientes, efectos y música. El Foley va dentro de efectos. En algunos flujos los ambientes y los efectos se manejan juntos como un solo grupo, pero en postproducción de cine lo más común es mantenerlos separados porque se procesan de forma diferente en mezcla. Esa estructura no es solo una convención de sonido: cuando el editor de imagen organiza su timeline con esa jerarquía — diálogos arriba, ambientes y efectos en el medio, música abajo — le está facilitando el trabajo al editor de sonido al momento de recibir el AAF. Las pistas llegan en un orden que tiene lógica, los grupos se identifican rápido y el tiempo de organización inicial se reduce. No es un requisito, pero marca la diferencia en proyectos donde el turn over llega con poco tiempo.

En la era del cine en película, un rollo era la unidad física de trabajo: una bobina de 35mm que en promedio contenía unos 24 minutos de imagen. El montaje se organizaba rollo por rollo porque esa era la capacidad real del soporte. Con la digitalización el rollo físico desapareció, pero la convención se mantuvo como unidad de organización editorial por una razón práctica: permite un trabajo escalonado dentro del equipo de sonido. El editor de diálogos arranca con el rollo 1; cuando lo termina, ese rollo pasa a ambientes y él sigue con el rollo 2. Cuando ambientes termina el rollo 1, lo pasa a efectos ya con diálogos y ambientes editados. Esa cascada hace el proceso más inmersivo para cada editor y las decisiones más precisas — trabajar solo con la referencia de imagen, sin los diálogos ya editados debajo, confunde más de lo que ayuda. En producciones de largo y mediometraje, donde el tiempo de postproducción de sonido suele estar acotado a seis u ocho semanas, esa forma de organizar el trabajo no es un detalle de flujo: es lo que hace posible llegar a la mezcla con el material bien trabajado.

Son las dos fases de postproducción de imagen, y entender la diferencia importa para saber en qué momento es correcto hacer el turn over. El offline es la fase de edición: se trabaja con proxies, con resoluciones reducidas, con archivos ligeros pensados para que el sistema responda rápido. Ahí se toman todas las decisiones creativas — el corte, el ritmo, la estructura. El online es la fase de finishing: se reemplaza el material de baja resolución por los archivos originales de cámara en su resolución completa, se hace la corrección de color, se integran los efectos visuales y se prepara el máster final. El turn over a sonido ocurre durante el offline — sobre el corte aprobado, no sobre el máster final. Eso significa que el video de referencia que recibe sonido es un proxy, no el material de cámara original, y está bien que sea así. Lo que no está bien es que llegue sin timecode, sin leads o en un codec que Pro Tools no puede leer.

Es el proceso de actualizar el trabajo de sonido cuando el corte de imagen cambia después de que el turn over ya se hizo. Si imagen mueve un clip, agrega un corte o elimina unos frames, esos cambios no se reflejan automáticamente en la sesión de Pro Tools — hay que resincronizar manualmente cada elemento afectado: diálogos, ambientes, efectos, música. El tiempo que toma depende directamente de cuánto trabajo de sonido ya había sobre ese material. Un reconformado en una sesión que apenas empezó puede tomar unas horas. Uno en una sesión avanzada, con tracks de ambientes y efectos ya construidos encima, puede tomar días. Hay herramientas que automatizan parte del proceso, pero ninguna lo resuelve por completo — siempre hay decisiones editoriales que requieren criterio humano. Por eso cada cambio después del Picture Lock tiene un costo real, aunque desde imagen no siempre sea visible.